2023年9月20日 星期三

2023年NVIDIA總部拜訪速記

2023年9月9日 星期六

Google I/O Connect 2023 速記

|

| 會場入口,本次活動每日有超過2,000個開發者參加

|

|

| 活動陣容也相當的大 |

|

| 滿滿中國風 |

|

這次的乾貨也相當的多,Jerry老師就分享一些跟AI比較相關的議題

首先是讓我印象深刻的DuetAI 的其中一項展示,可以透過Looker ML技術,把資料結合BigQuery把資料撈起來,再透過PaLM把答案做萃取,接著透過ML做一下迴歸預測,把結果輸出後,再自動產生簡報,以前要花好多時間做的事,現在完全一氣呵成。

展示影片:https://www.youtube.com/watch?v=bUHP-XzHUFE

再來是生成式AI可能為組織帶來的風險

前三名包含敏感資料會洩漏(69%)、錯誤與幻覺(52%)、偏見(50%)等。所以在實務上面模型的使用,更需要專業團隊 或是 工具 來去降低這些風險。

當然免不了Vertex AI 還是今年主打的工具之一,各種AI的PaaS服務支援,都可以在Google Cloud上找到

再來是生成式AI的應用場景

LLMs的議題大家都在討論,而這張圖滿能夠去解釋,整個趨勢的變化

從過去規則判斷,到AI閱讀大量資料,可以理解並表達資訊,整個AI技術從分類、理解、預測、生成這幾個面向快速的發展。

但事實上生成式模型已經大量成長在市場上

從數據上來看有超過50%企業沒有AI的團隊可以協助落地

但有超過80%的高階主管認為 AI技術有助於所有業務決策

而從模型投入到生產事實上有非常多挑戰

包含從模型訓練 到 模型推論,而一個好用的工具或平台就變得重要。

目前Google Cloud支援開源部署的機器,包含最新的TPUv5 、 A3(NVIDIA H100)

重點是都支援了GKE、GCE。

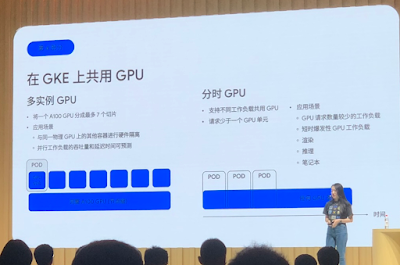

根據統計平均GPU使用率在25%左右

所以在GKE上面用一塊A100 GPU以切片的方式來使用,GKE的群集上

最多可以支援15,000個節點。

也因為基礎設施跟AI有密切關連,所以Google提出了LLMOps的概念

這張圖試圖將模型訓練、模型服務、模型管理、模型治理都連貫一起

Jerry老師跟覺得LLMOps這是一個新工作,同時要具備底層、模型能力,相當的不容易

所以這張分工圖就顯得重要

從使用場景來看

如果我們希望AI由Google做託管,我們選Vertex AI

如果希望自己多一點關心底層,我們可以選GKE+Vertex

如果AI要自己來,多點DIY,我們可以選GKE

而這些技術 都能夠在VertexAI上獲得到。

這次活動免不了要更新一下PaLM2的發展,最大不同於PaLM2新版,提供了32K的輸入上下文,跟GPT-4一樣的輸入量,再來也有支持多輪對話、程式碼生成等。

另外就是 Google最強大的BigQuery功能,也與ML、GenAI做了許多結合,像是BQML(BigQuery ML),結合Google ML技術,譬如說對大量資料進行迴歸等。

同時可以透過 Cloud AI MaaS來實現對PaLM模型的使用

最重要的是面對多樣的資料型態,可以透過BQML將結構化與非結構化做資料整合,用於機器學習預測。

透過wide-and-deep來進行推薦系統

https://cloud.google.com/vertex-ai/docs/tabular-data/tabular-workflows/wide-and-deep-train

或是透過Vertex LLM做客戶分群、戰略分析

做房源的點擊率

透過影像辨識貼標

透過GenAI重新生成新行銷圖片

裡面乾貨也包含這個

整個多GPU運行AI環境的建構,以及搭配GKE的範例

https://github.com/googleCloudPlatform/stable-diffusion-on-gcp

近期流行的向量資料庫,也有些乾貨可以參考,包含生態

而Google也有推出類似的服務,像是VME。

同時也有分享關於Langchain的問答架構

甚至是IoT整合LLMs場景

遊戲的GenAI整合

新工具

https://github.com/google/visualblocks

喜歡直接用模型的可參考MediaPipe Studio

https://developers.google.com/mediapipe/solutions/studio

JAX to JS ,我們知道TF.JS是全球在JS針對AI的部分下載量是最多的套件,而很高興JAX開始支援JS,這將讓我們從應用端到研發端能夠做更好的連結。

我們都知道XLA是Google推出的一個加速模型很重要的編譯器,而Google本次發表了OpenXLA ,看起來是想要在XLA找到社群的平衡。

完全認同做AI的挑戰相當多,所以我更需要有更好更快的方式來實現AI模型的互動

歡迎初學者可參考

對NLP有興趣可參考

對CV有興趣可參考

Keras未來將完全支援TensorFlow, JAX, and PyTorch,使用者不需要再煩惱要用哪一個框架。使用mediapipe的朋友如果想訓練客製化模型,也可以直接學Keras,然後再搭配mediapipe去做應用,如果想挑戰深度的客製化模型,會建議採用TensorFlow、JAX,或是Pytorch 。但總而言之Keras未來將會完全深度整合這些知名框架,所有的開發者請安心使用。

歡聚時光中,我們跟許多Google大大們以及社群朋友做了許多交流,收穫很多。

這個活動參與包含GDG、WTM、GDE,感謝Google,如果您也是Google的開發者,或是正在成為開發者的路上,歡迎加入我們大家庭。

GDG Taipei:

WTM Taiwan:

GDE:

https://developers.google.com/community/experts

這是一個臥虎藏龍的技術社群,Jerry老師在這裡認識了來自Intel、huggingface、微軟等技術高手,歡迎大家一起來交流學習與成長。